0.前言

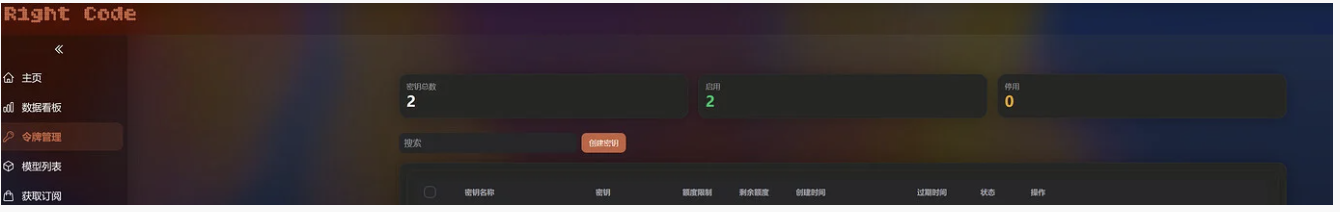

Open code的配置一直是比较繁琐的,虽然开箱即用,但如果想配置转发站就有点头疼了。在网上找了很多教程,但大都简略,很多第三方转发站的文档写的也不明白(点名Right Code)。

有很多佬友开发了可视化/后端插件,如AI-toolbox,OCCM,CLIProxyAPI。这些都很好用!感谢佬友们!你们的贡献让社区变得如此美好,也深深激励了我

在使用了一段时间后,我发现掌握一些模型config配置原理是有必要的.插件只能帮忙切换provider,每个模型的进阶参数如思考预算,仍然要自己配置.懂得如何修改配置文件也能让我们把这些插件用的更好.

所以写一篇教程,从0开始配置opencode.json.希望能帮到各位尝试opencode(并想在opencode中配置使用自定义转发站)的佬友,同时也记录自己学习各类官方文档的过程

comment 1: 通过本教程你可以收获:

- 通过截图和我一起配置文档一坨但富可敌国的转发站作为Provider

- 一起看懂模型接口,Opencode,AI-SDK官方文档

- 了解并动手设置Claude和OAI不同模型和接口的参数配置(如思考预算)

comment 2: 本教程重点在于详细和实操,不是一个面面俱到的教程.

篇幅所限,本篇教程大部分内容是折叠的!!!请点击黑色三角形展开查看!!!

篇幅所限,本篇教程大部分内容是折叠的!!!请点击黑色三角形展开查看!!!

篇幅所限,本篇教程大部分内容是折叠的!!!请点击黑色三角形展开查看!!!

1.初始化

action 1:如果你已经有opencode.json就可以跳过

如果你没有安装opencode:

请参考此链接安装opencode TUI版Opencode|Github

如果你有opencode:

查看在C:\Users<你的用户名>.config\opencode目录下是否存在opencode.json

如果没有,请不要手动创建。经过第二节的Provider配置,它会自动产生在这个目录下。

2.Provider配置

2.1 官方Provider配置

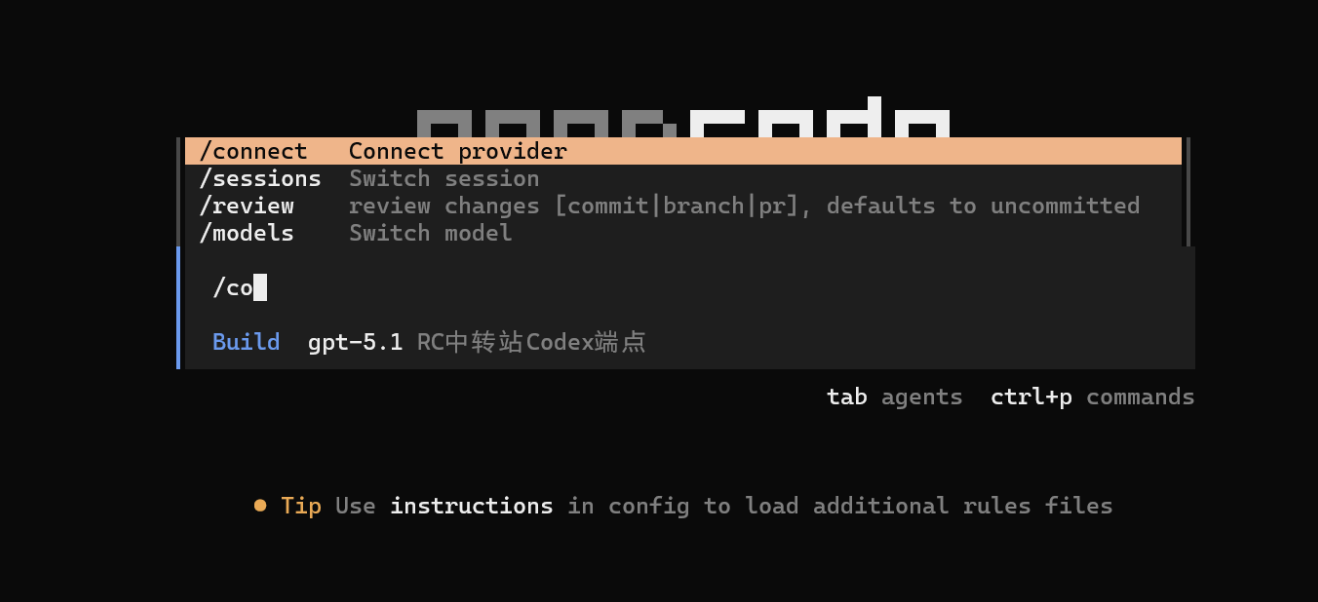

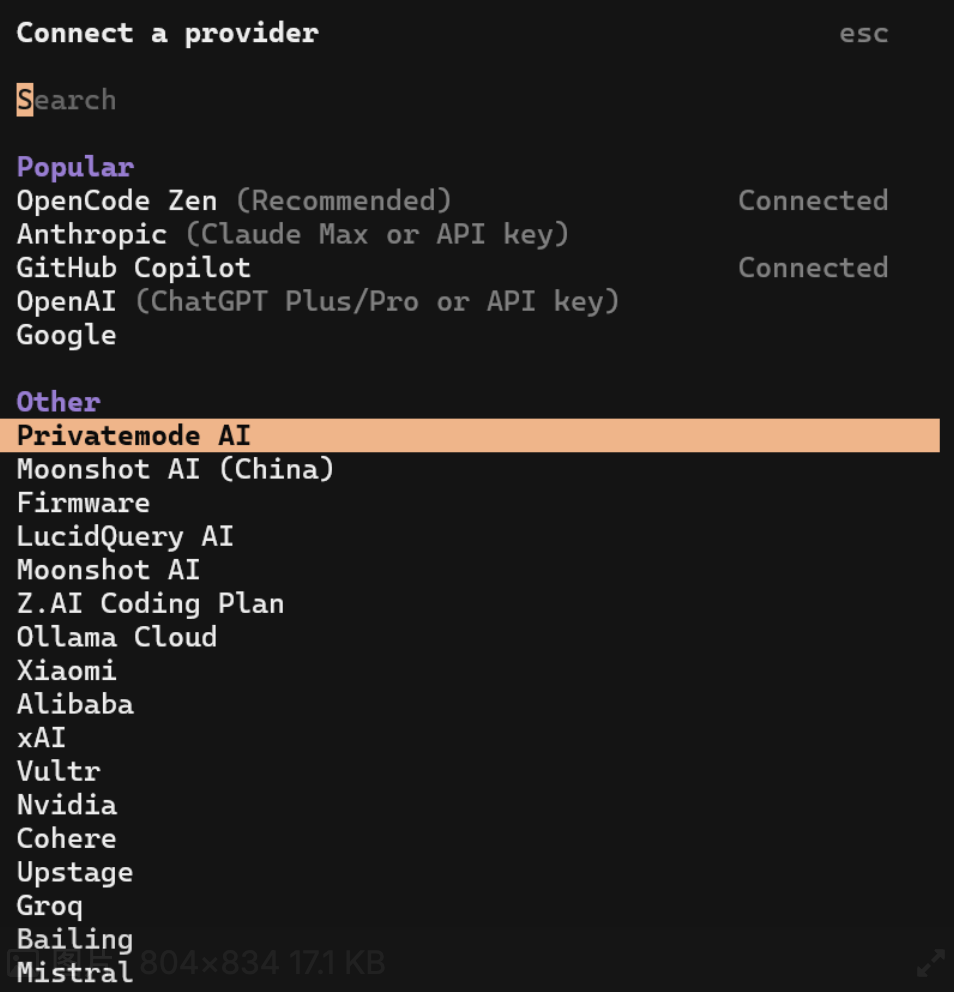

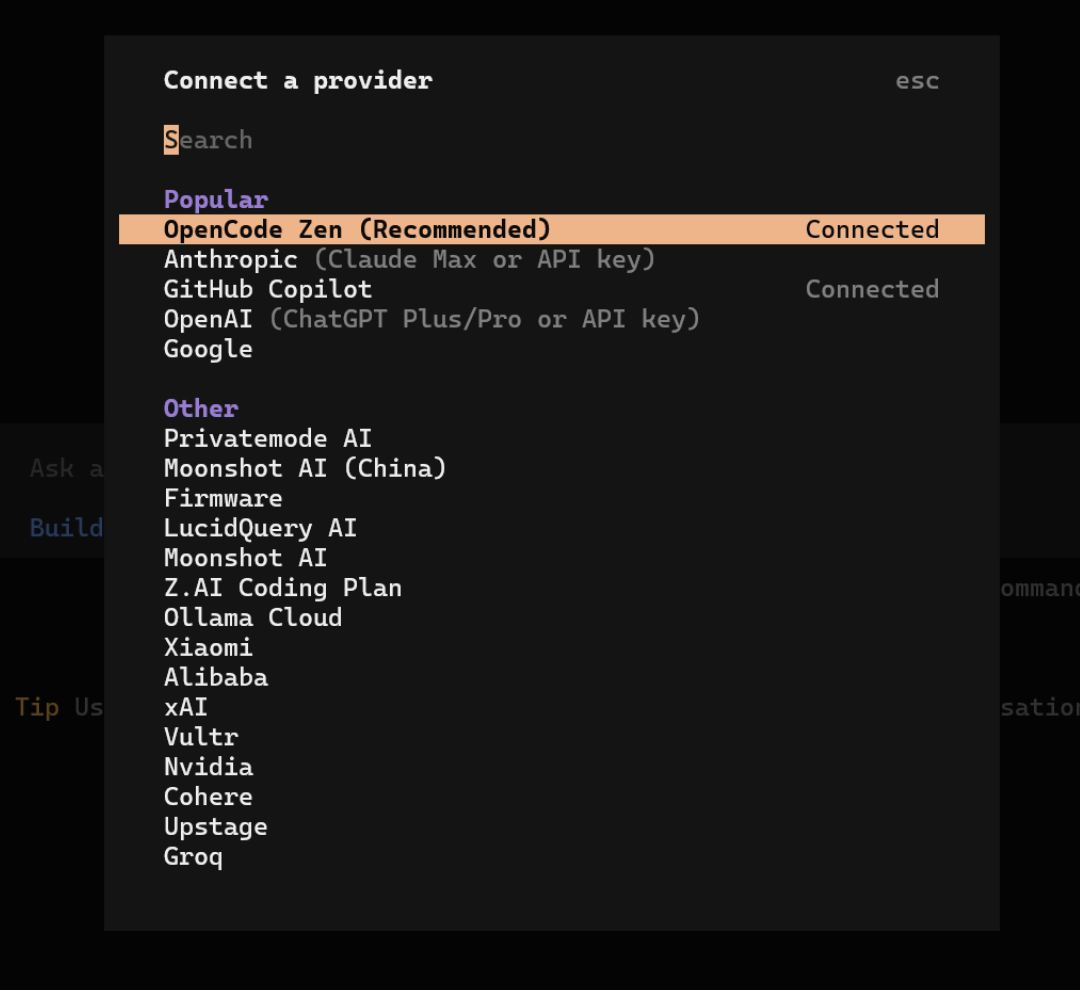

如果你使用的是Opencode官方支持的Provider,例如Opencode Zen,GLM Coding Plan,那么基本上只需要在安装好的opencode TUI中输入/connect并回车即可。

如果你想在这篇文档中找到含截图配置教学,请展开以下三角形

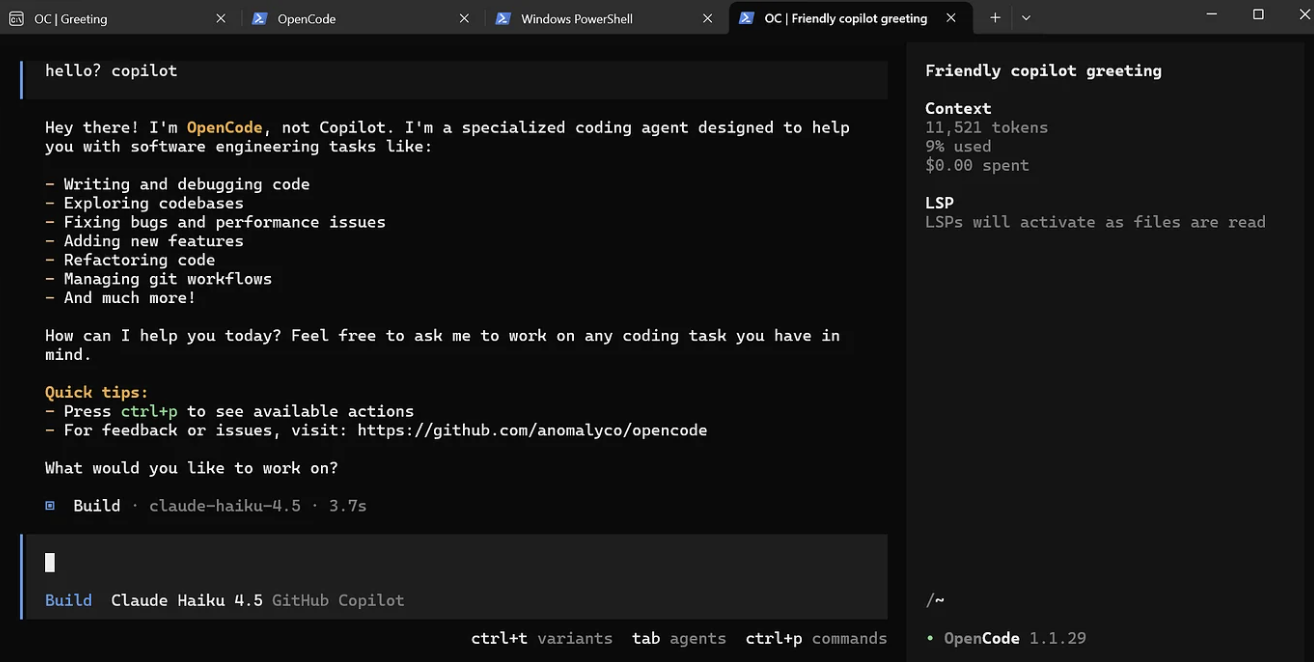

action 2:连接Github Copilot作为Provider

打开opencode,输入/connect

选择github copilot或其他official provider

按提示操作

恭喜你!验证成功!  现在可以通过opencode使用copilot或其他official provider了。

现在可以通过opencode使用copilot或其他official provider了。

注意:只需要重新走一遍此流程就能覆盖之前的认证

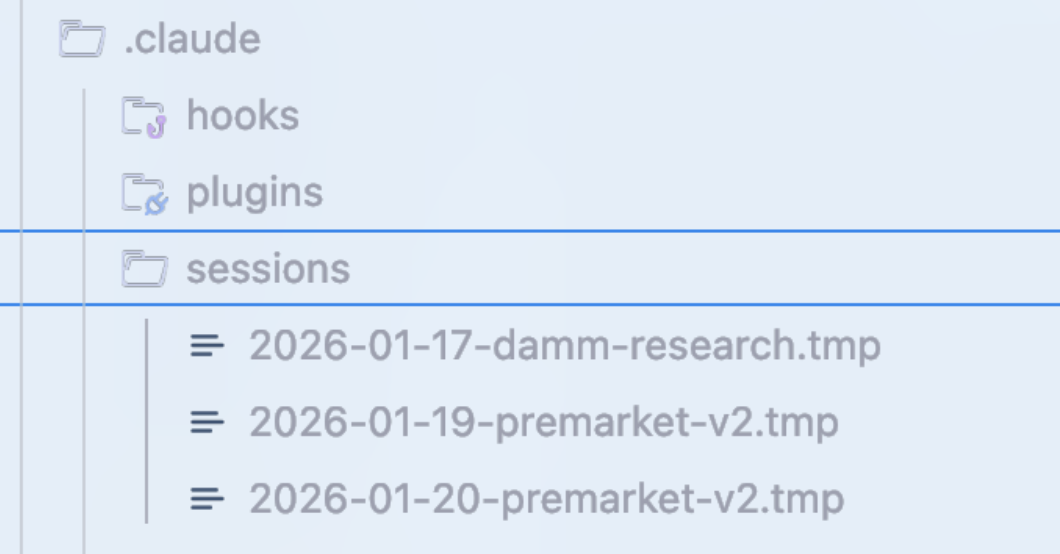

Provider auth的文件在这里:C:\Users<你的用户名>.local\share\opencode

如果对此流程具体涉及的文件感兴趣,拓展阅读在2.2节action4提供

reference 1:相关文档

2.2 自定义API Key/转发站Provider配置

如果你想在这篇文档中找到含截图配置教学,请展开以下三角形

action 3:通过可视化方式连接Right Code(转发站)作为Provider(推荐)

如果使用action3,最好也看一下action4

以便于理解后续Models配置部分对.json的自定义修改。

Opencode的逻辑是由开发者来列出所有合法的provider供连接,非常全。但Right Code这样的转发站理论上确实不受opencode支持。

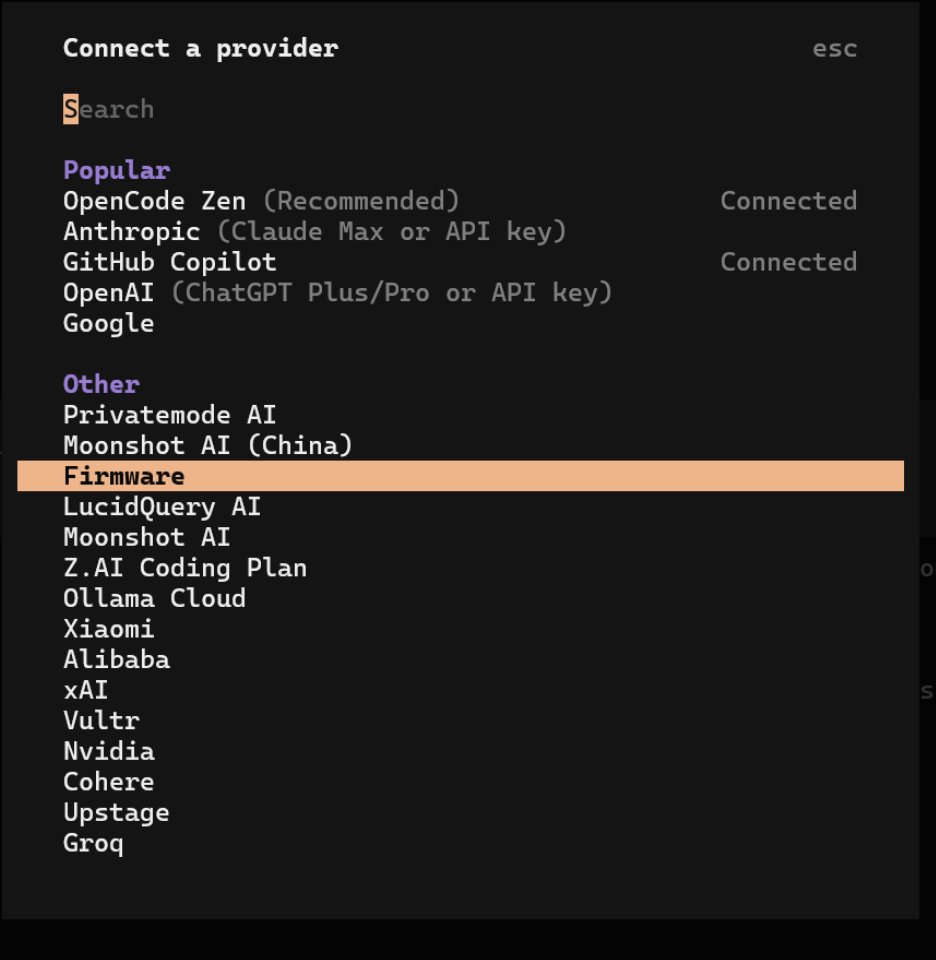

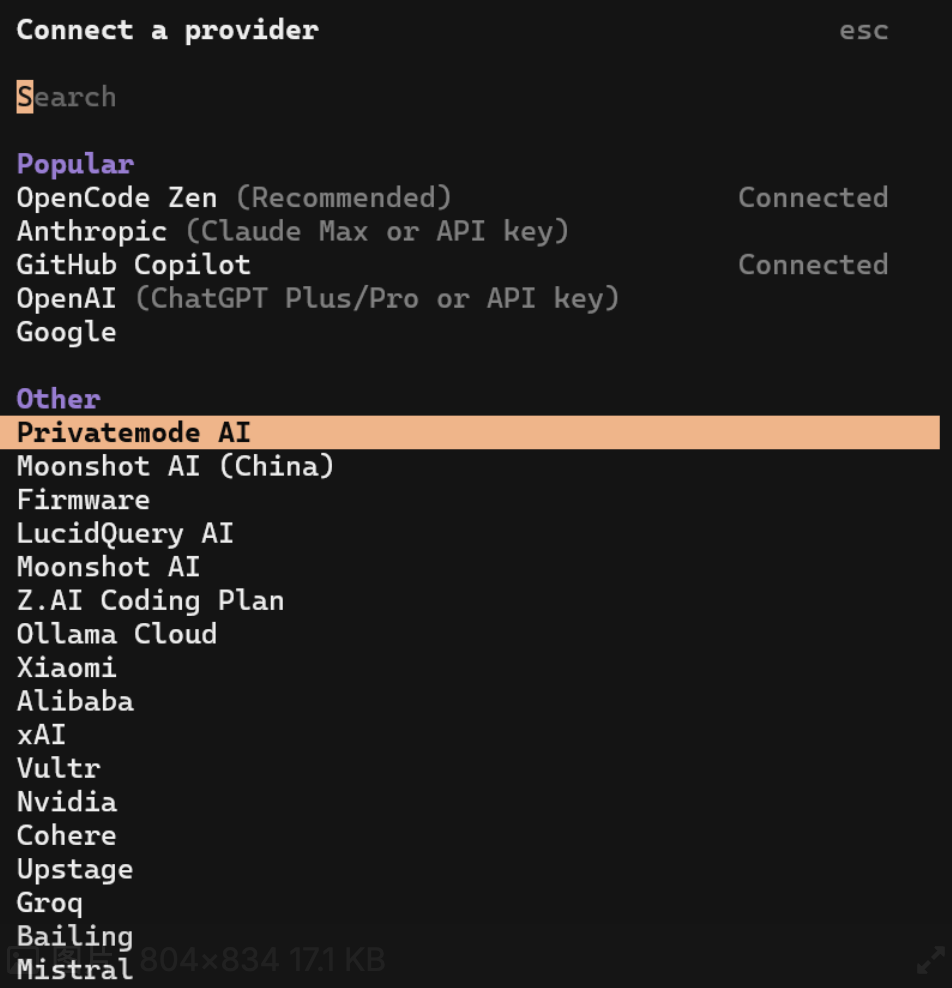

大部分佬友遇到的困难集中在使用opencode命令打开TUI(Terminal UI)界面后,/connect的provider中没有”other”或者”custom”选项。我们可以看到Other选项是个标题,确实不能选Other选项,而且经过搜索Other里面也没有Right Code这样的转发站。

不过,我们仍然可以通过配置opencode.json来解决这个问题。

@coulsontl

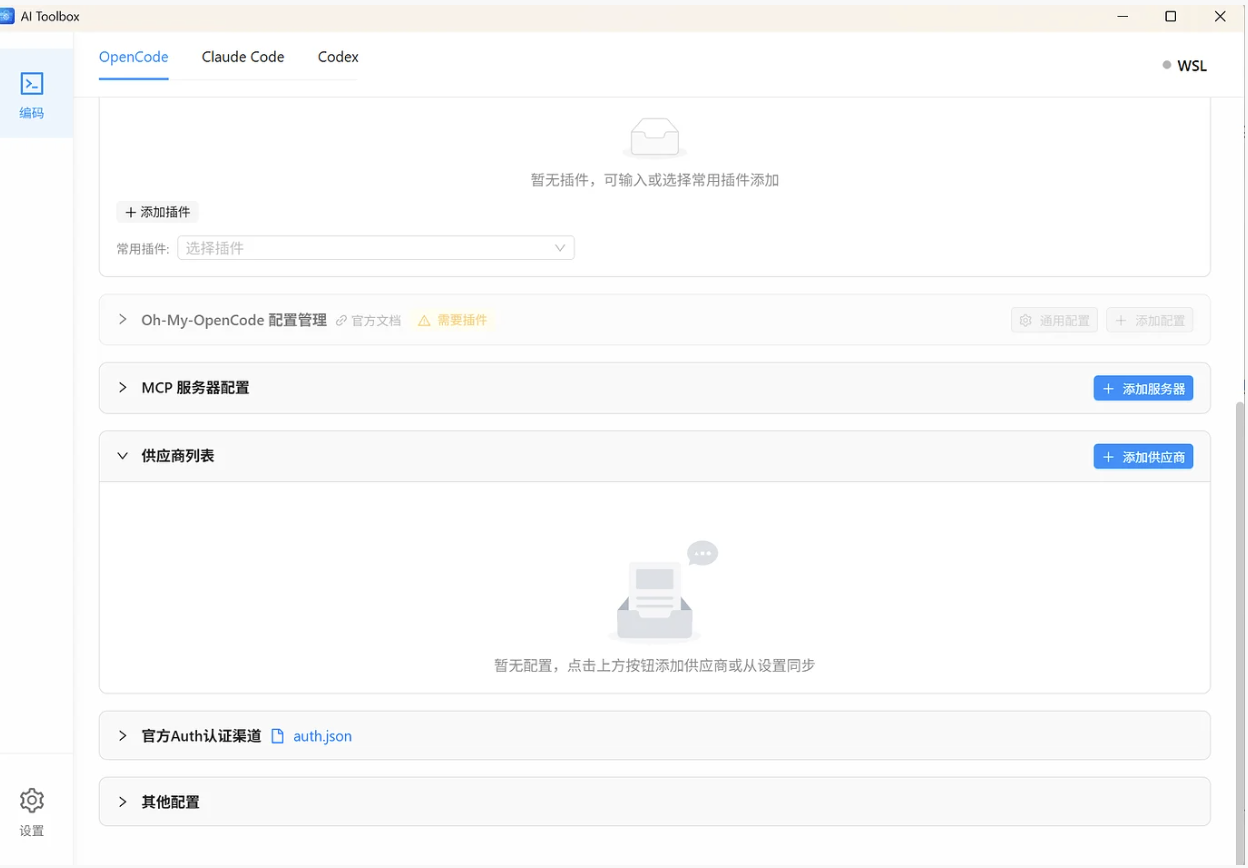

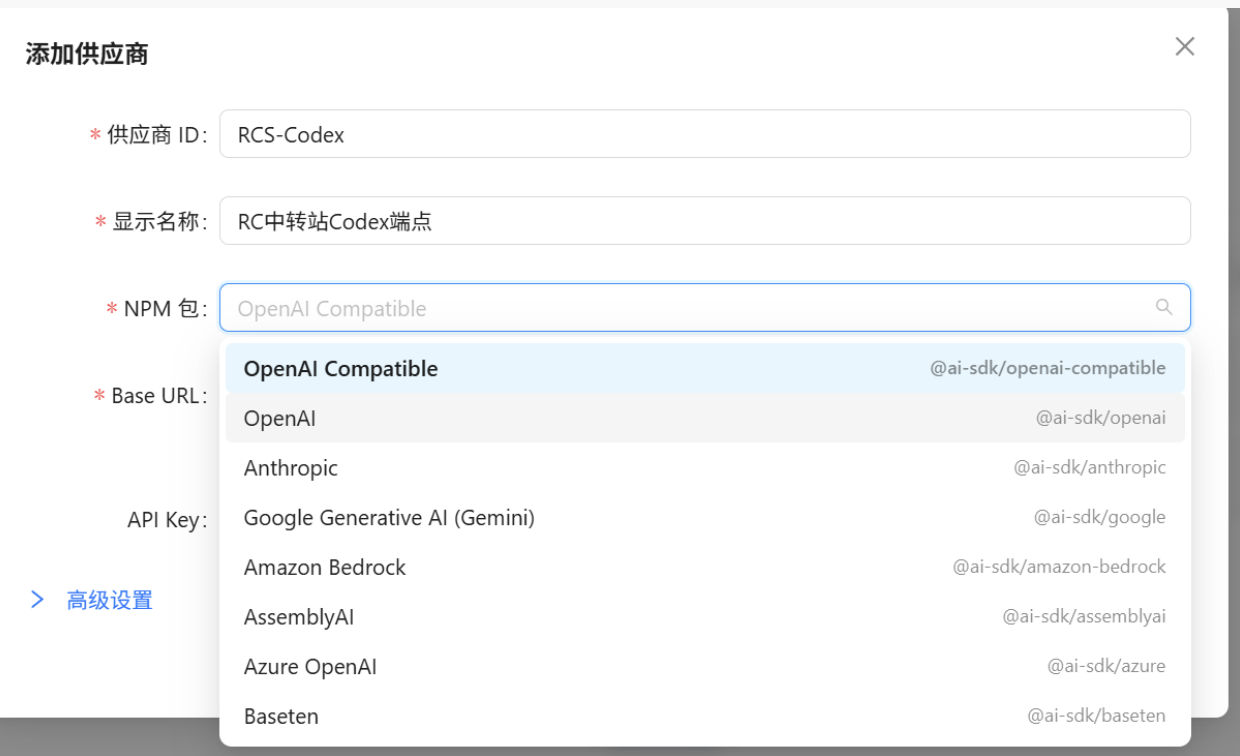

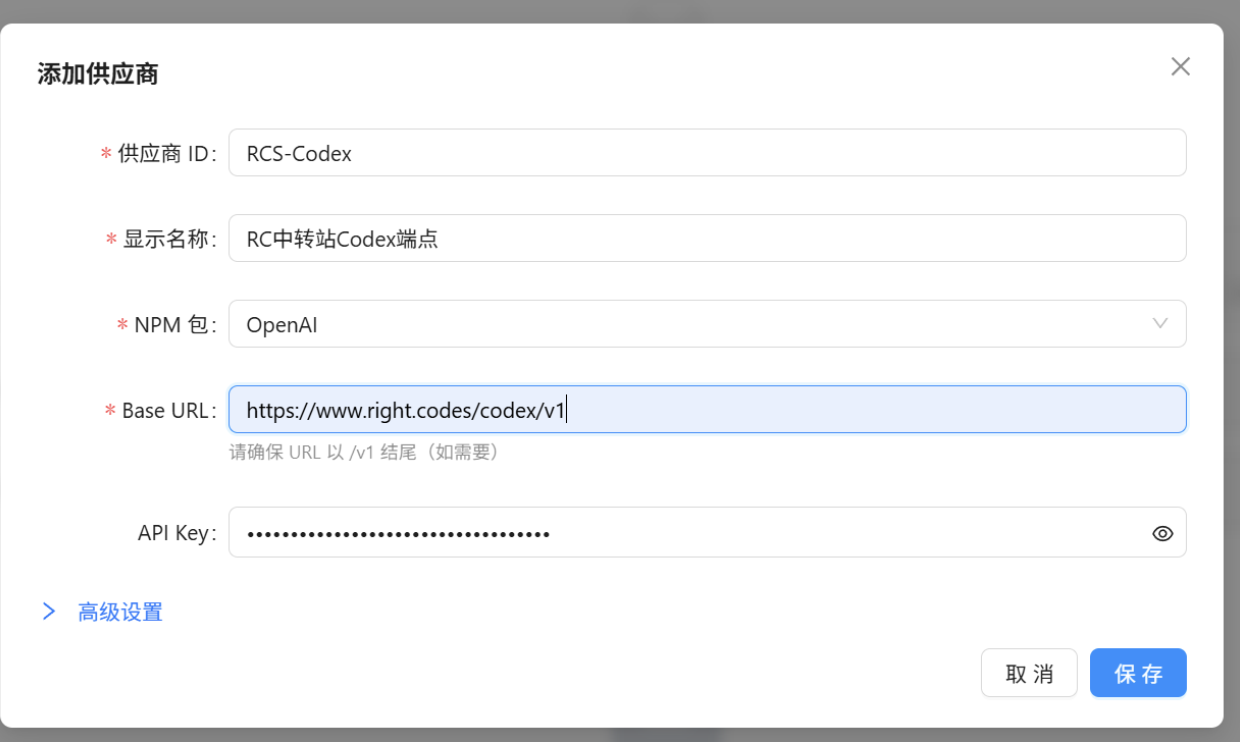

使用佬友的项目AI-toolbox可视化配置opencode.json和auth:

step 1:下载并安装releases.

step 2:填写你想自定义的供应商名和显示名

step 3:按照图片填写NPM包和BaseURL即可

step 4:点击“获取模型”,在列表中添加想用的模型

step 5:已经可以使用了。Oh-My-Opencode也可以配置此种模式导入的模型。

非常好用!感谢coulsontl佬友!

不支持自定义Options/Variants配置,导入新Provider会覆写旧文件

也许后续我会提PR?

如想知道如何填写NPM包和BaseURL,请参考document-reading 1!

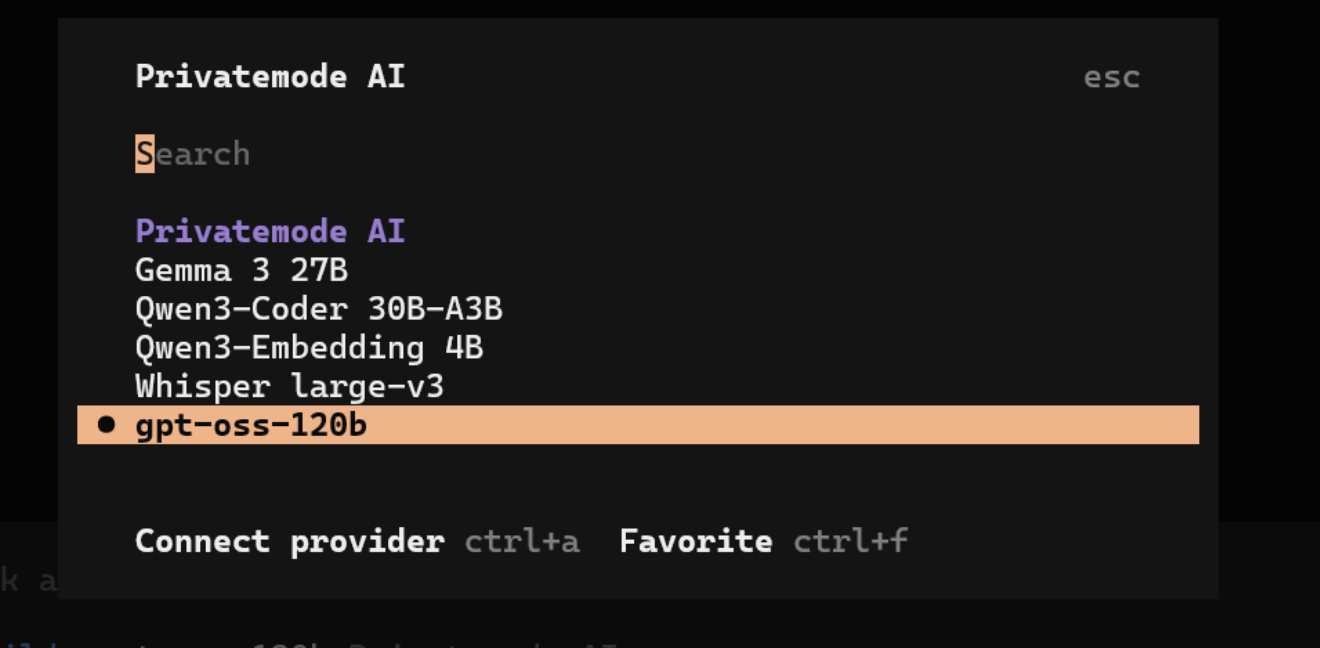

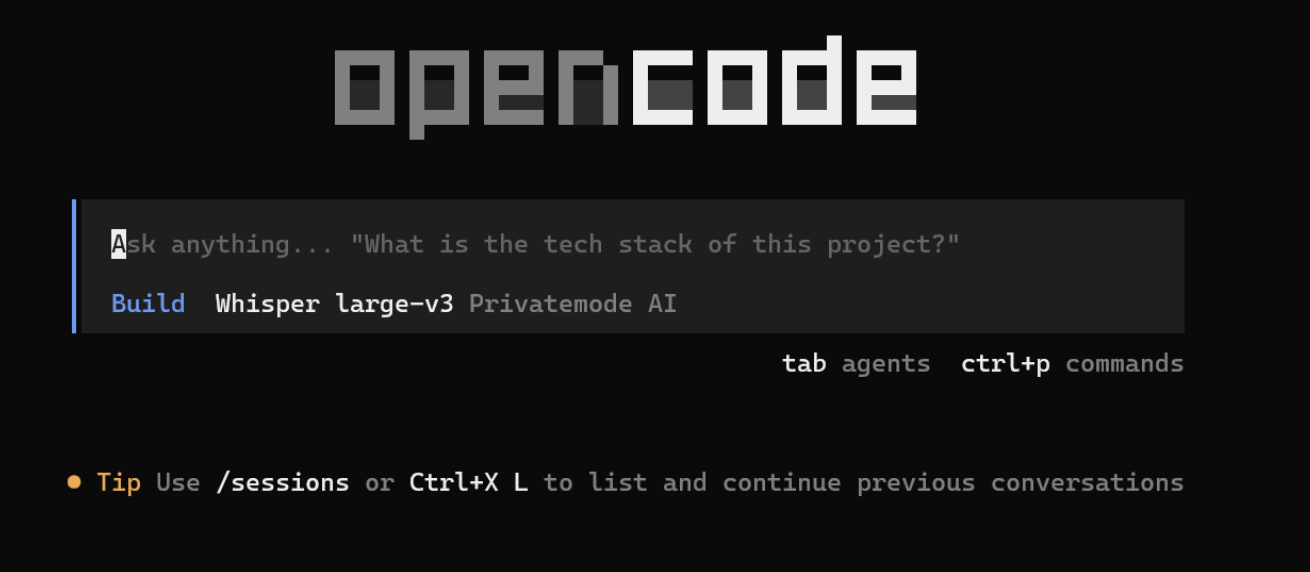

action 4:通过/connect方式连接Right Code(转发站)作为Provider

Opencode的逻辑是由开发者来列出所有合法的provider供连接,非常全。但Right Code这样的转发站理论上确实不受opencode支持。大部分佬友遇到的困难集中在使用opencode命令打开TUI(Terminal UI)界面后,/connect的provider中没有”other”或者”custom”选项。我们可以看到Other选项是个标题,确实不能选Other选项,而且经过搜索Other里面也没有Right Code这样的转发站。

TUI中/connect选项设置基于默认的合法auth。不过,我们只需要随意在没有连接的选项中选一个然后改成我们的auth就可以了。

这里选择privatemode AI,随意填写一个api key

随意选择一个模型

虽然看起来能用,但这显然这是不能用的。

接下来的才是重点:我们去修改这个auth为Right Code的auth和model。

Provider auth的文件在这里:C:\Users<你的用户名>.local\share\opencode

如果你之前连接过其他的方案,例如github copilot,也会在这里显示。同时,你可以删除这里面的配置,TUI里会同步更新,相信可能会有佬友配错了想disconnected但找不到路子的,请修改这个文件,删除对应部分即可。

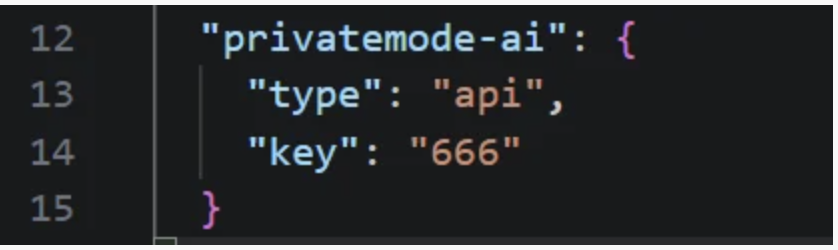

我们可以看到这个文件中已经新增了刚才我们选择的Provider privatemode AI的 Auth,key为666。

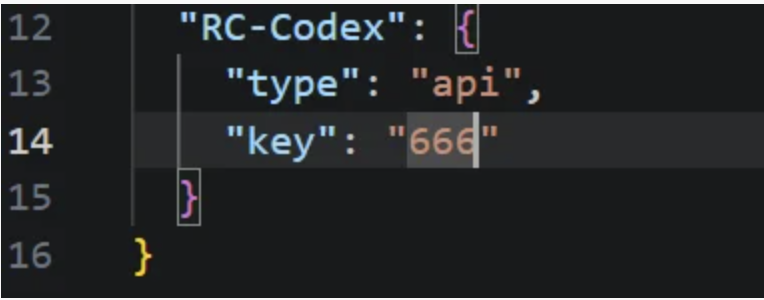

然后,修改provider name为一个你喜欢的名字,我这里修改为RC Codex,key填写为你的apikey。需要修改,否则自动识别,勿与opencode的内置provider(例如刚才的privatemode AI)同名。

(我这里填写666是为了占位,请在转发站生成api key并填写。下图为获取api-key的界面)

那么auth就配置完成了!

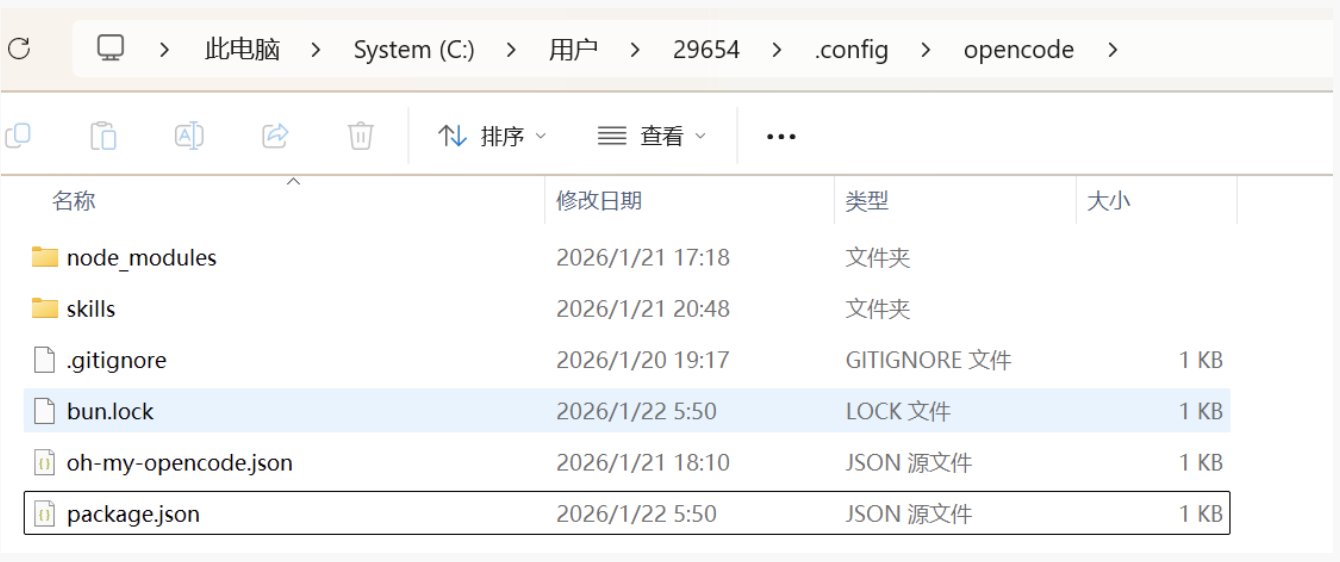

接下来请转到C:\Users<你的用户名>.config\opencode

查看是否有opencode.json或.jsonc

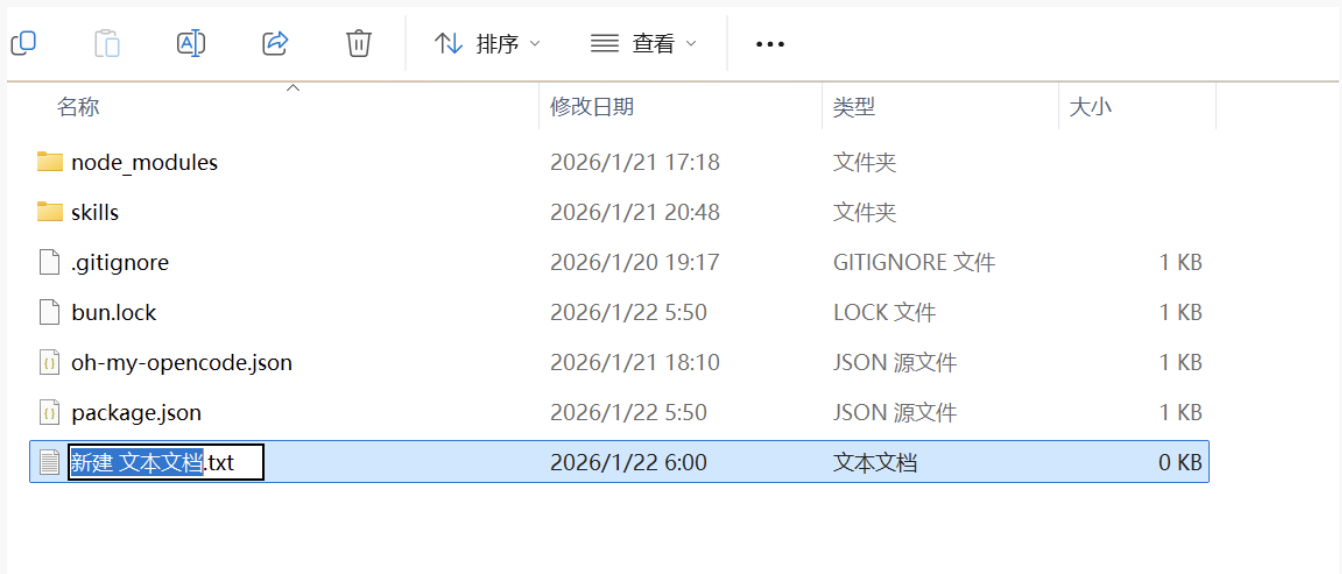

我这里就没有。如果没有,创建一个。

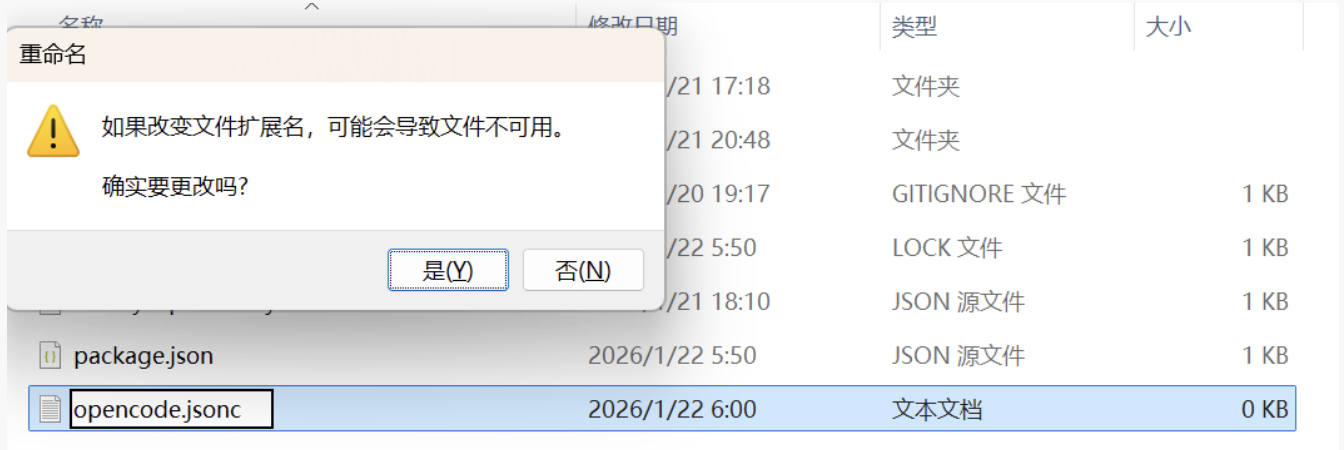

可以把auth.json复制过来创建。如果右键创建,记得显示扩展名。

此处jsonc和json的区别是jsonc可以写批注。c是comment的意思。其他没有区别。

创建完毕后,写入对应于provider auth的model内容,参考示例如下。具体需要配置的部分都进行了注释,将由document-reading 1来详细讲解,以便大家知道为什么这么配置,进而配置不同的转发站。

{

"$schema": "https://opencode.ai/config.json",

"provider": {

"RC-Codex": { // 和auth中修改的名称一致

"npm": "@ai-sdk/openai", // 兼容的SDK,将于后续document-reading 1详细讲解

"name": "RingCode-CodeX", // 在 TUI 中显示的名称

"options": {

"baseURL": "https://www.right.codes/codex/v1", // 中转站 API 地址(必须以 /v1 结尾或符合 OpenAI 格式),将于document-reading 1中详细讲解

"apiKey": "666"// 明文填写你的api-key,懂得引用的佬友可以用引用形式

// 如果中转站需要自定义 headers,可添加:

// "headers": {

// "X-Custom-Header": "your-value"

// }

},

"models": {

"gpt-5.1-codex-max": { // 中转站支持的模型ID,例如 gpt-4o、claude-3-5-sonnet 等,将于document-reading 1中详细讲解

"name": "Codex-5.1-max(RC-Codex)" //自定义显示名称

},

"gpt-5.1": {

"name": "Gpt-5.1(RC-Codex)"

}

// 添加更多模型...

}

}

}

}

此opencode-config.json参考来源

- document-reading 1

- 官方文档:https://opencode.ai/docs/models/

- 站内轮子:https://linux.do/t/topic/1329050

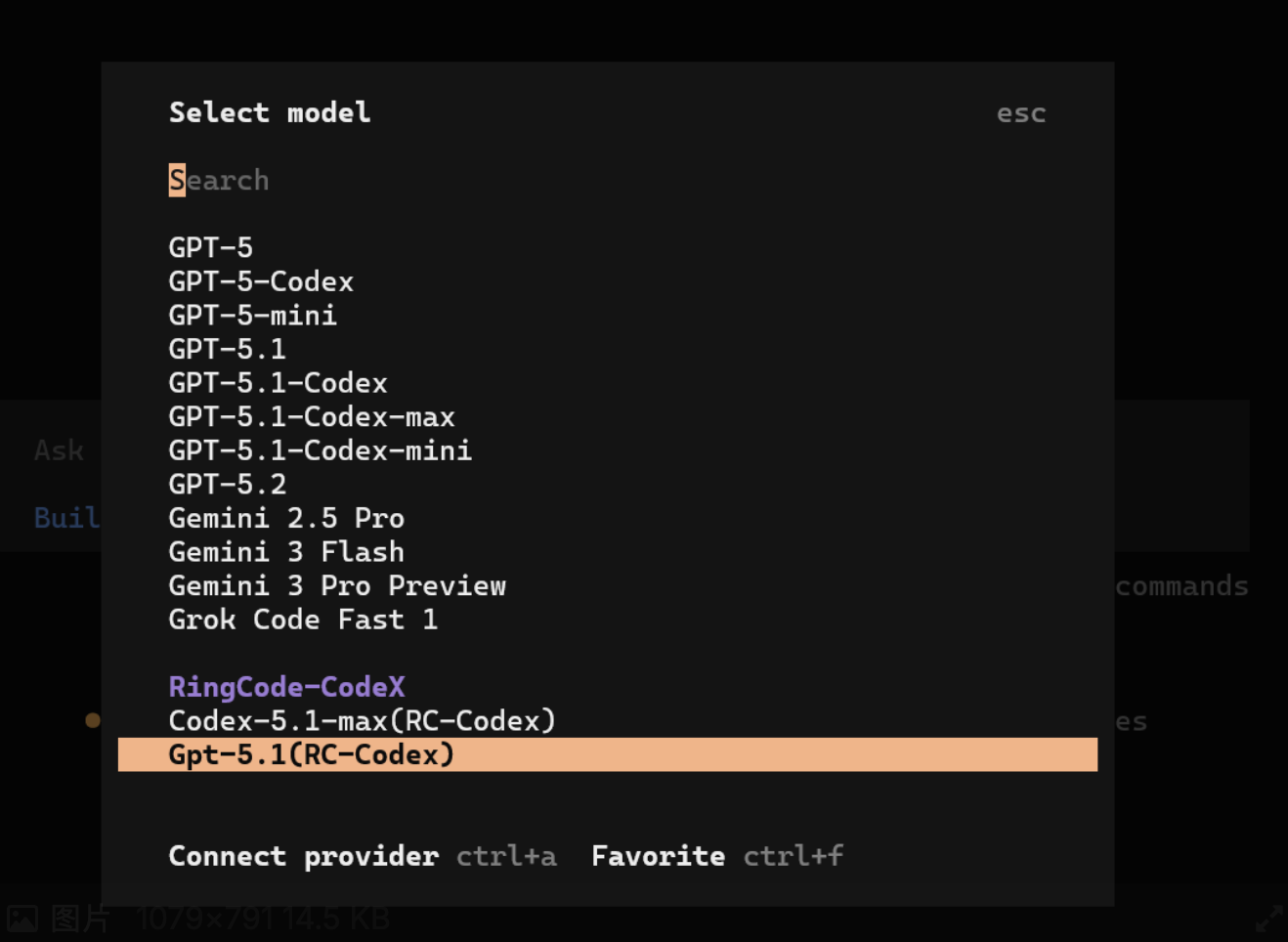

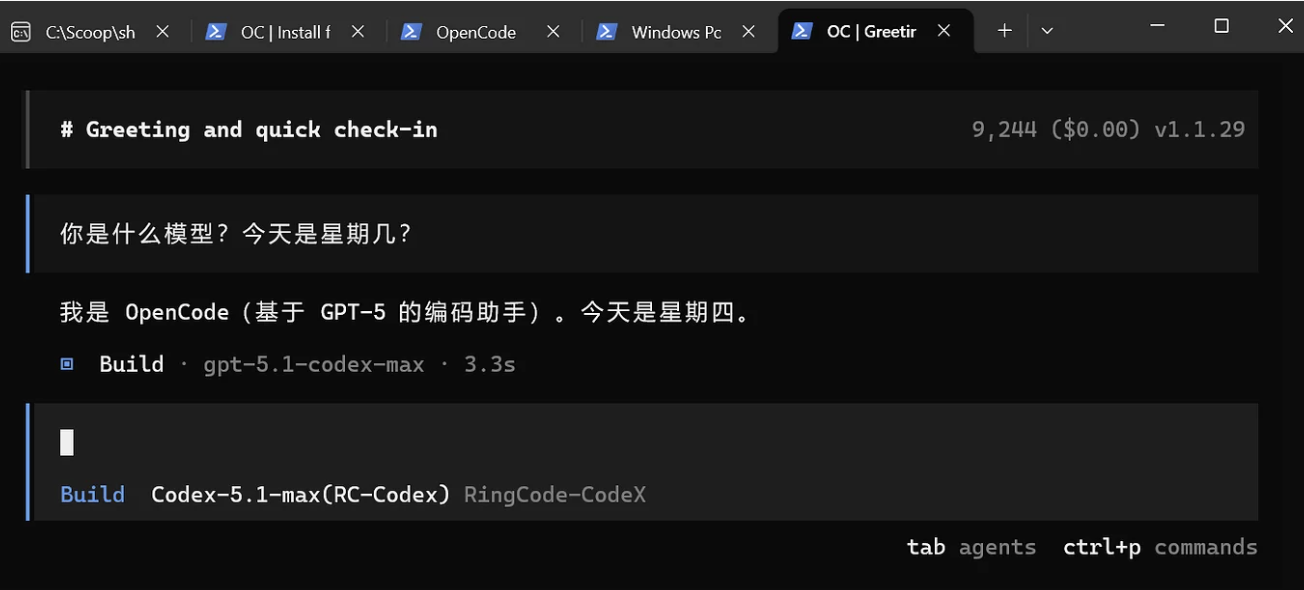

配置完成后,我们就可以愉快地重启opencode,选择codex模型了。

什么…?你用的不是Right Code不知道注释的地方填什么?你需要阅读官方文档!

请在document-reading 1和我一起阅读文档!

来看看我是怎么在Right Code文档完全一坨的前提下填写这些字段的。

(声明:Right Code是我最喜欢的转发站之一,codex量大管饱,没有不喜欢的意思,但是文档和网站确实需要改进)

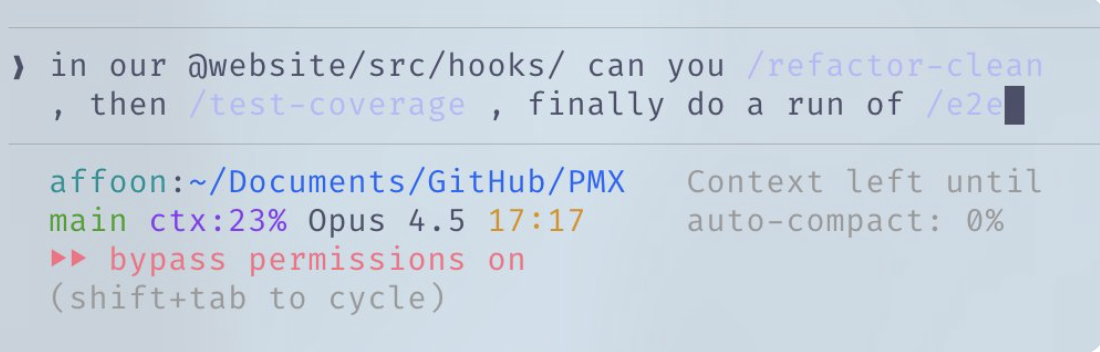

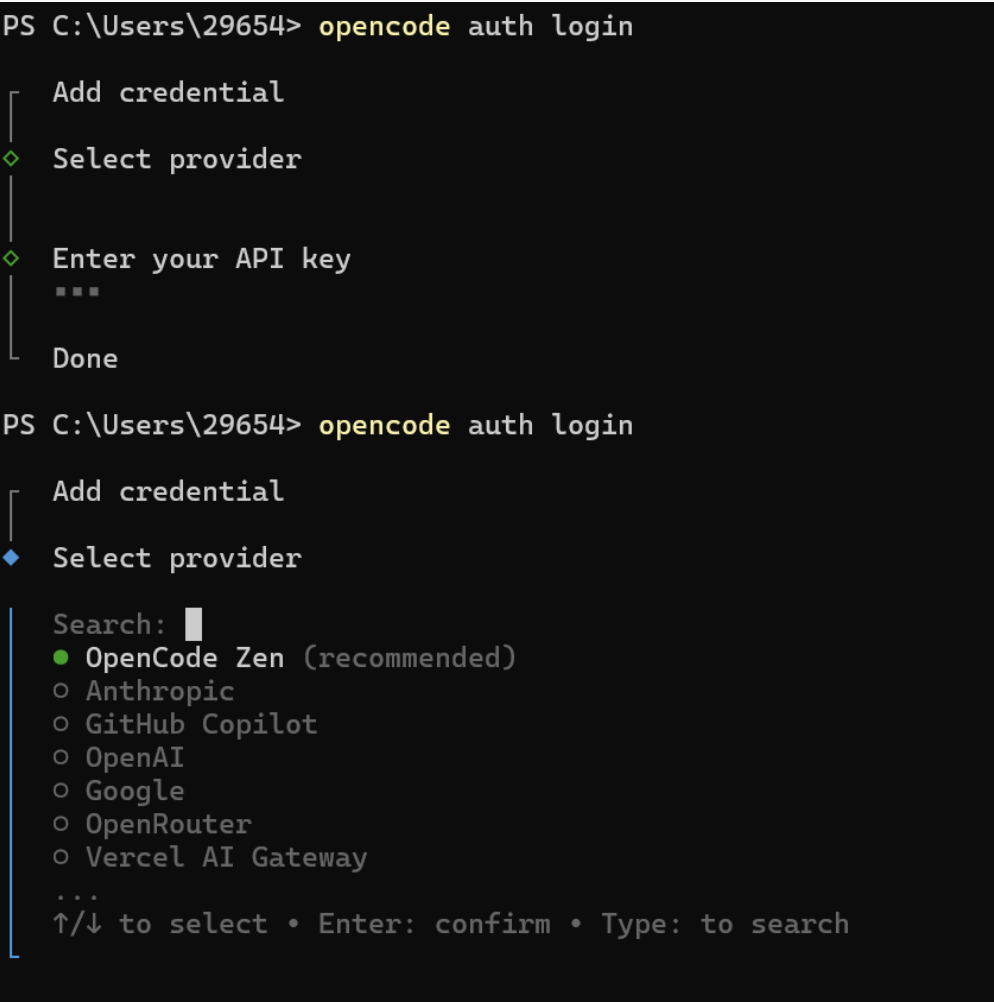

action 5:通过auth login方式连接Right Code(转发站)作为Provider

通过在powershell中输入opencode auth login配置

TUI的打开命令是opencode,那么其实opencode是一个程序,TUI其实就是无参运行这个程序。可以想象,其实带参运行这个程序是才是触发程序中内置的功能比较常见的途径。那么/connect对应的带参运行其实就是opencode auth login.

输入opencode auth login后,可以自由键入provider名字然后enter,找不到也没事,这是区别于(1)选项重要的一点。

其余选项,对于文件的修改都相同,请参考action 4。

注意起名勿与opencode的内置provider同名。

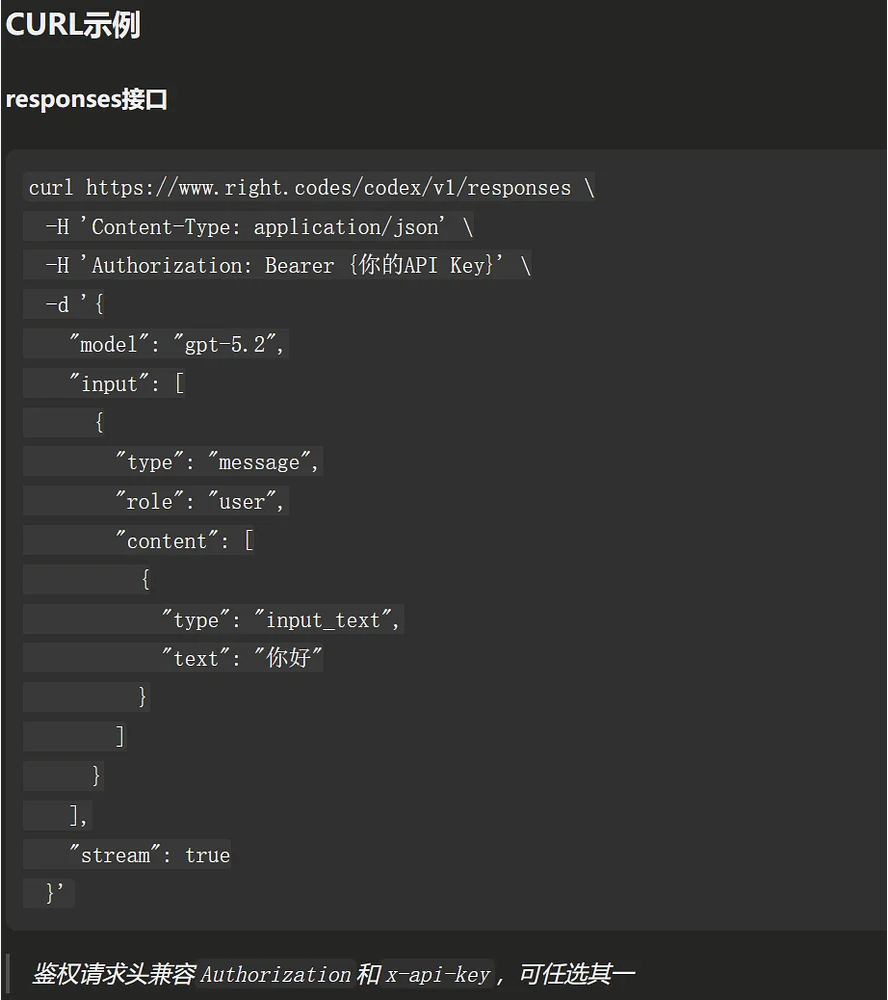

document-reading 1:通过阅读Opencode和转发站官方文档配置Provider

RightCode的文档和网站是最草率的那一批,但我们仍然可以获得足够的信息。

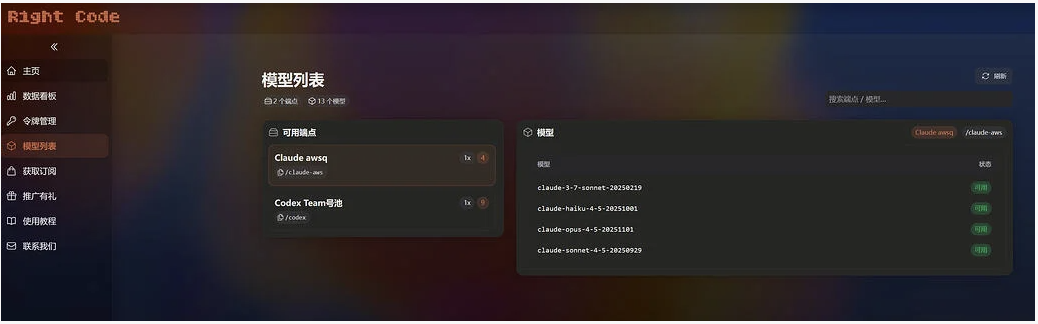

step1:获得转发站baseurl以填写baseurl字段

在RightCode官方文档中没有提到Opencode如何配置,也没写BaseUrl。

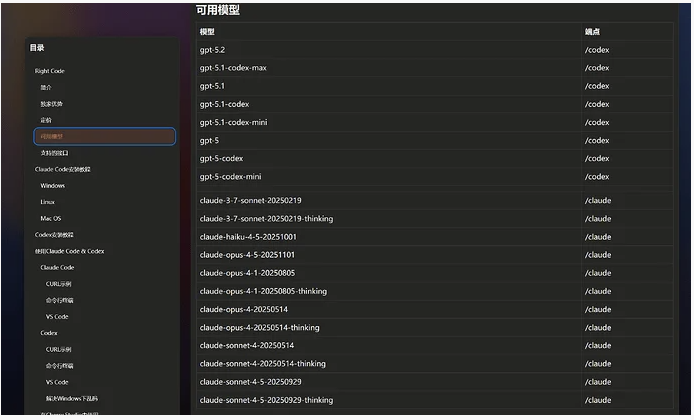

在模型列表可用端口处点击复制按钮,

分别得到https://www.right.codes/claude-aws

和https://www.right.codes/codex,那么加上v1,这就是两个模型池分别的BaseUrl。

为什么加上v1:

RightCode文档里也加了。v1是通用的接口规范,如果接口请求不对,没有v1就加上v1

通过以上信息可以填写如下的baseurl和apikey部分(apikey获取此处省略)

"options": {

"baseURL": "https://www.right.codes/codex/v1", // 中转站 API 地址(必须以 /v1 结尾或符合 OpenAI 格式),将于document-reading 1中详细讲解

"apiKey": "666"// 明文填写你的api-key,懂得引用的佬友可以用引用形式

// 如果中转站需要自定义 headers,可添加:

// "headers": {

// "X-Custom-Header": "your-value"

// }

},

step2:填写models

在模型广场里找到了如下的模型

在使用文档也里找到了如下的models可以填写。

因此可以填写config文件中对应的这几行。(注意:实际支持5.2codex,以模型广场为准。这文档不全)

"models": {

"gpt-5.1-codex-max": { // 中转站支持的模型ID,例如 gpt-4o、claude-3-5-sonnet 等,将于document-reading 1中详细讲解

"name": "Codex-5.1-max(RC-Codex)" //自定义显示名称

},

"gpt-5.1": {

"name": "Gpt-5.1(RC-Codex)"

}

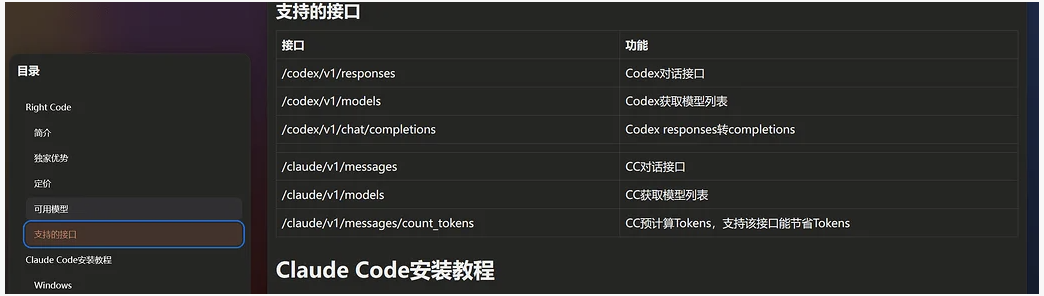

step3:获得转发站支持的接口以填写npm字段

我们可以看到Right Code支持了Openai 新版responses和老版chat/completions接口,也支持了Antropic新版messages接口。

那么知道了支持的接口该怎么填写npm字段呢?这个字段好像也不是接口。

不知道什么意思的时候就请查看Opencode官方文档。

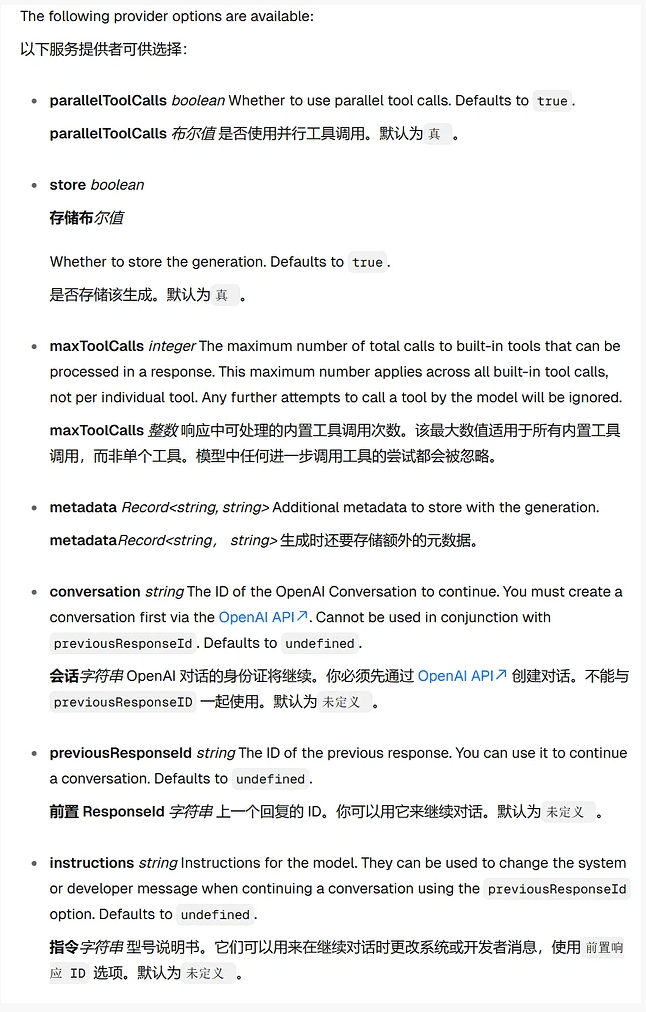

根据 Models | OpenCode opencode是基于Vercel的AI SDK项目(实际上大部分AI工具都基于AI-SDK转发请求)和models.dev项目的。所以去查看这两个项目的官方文档。models.dev看了之后和我们的需求没什么关系,opencode.json的实现是依赖于AI-SDK的。AI-SDK表示接口的实现依赖于对应的npm包。也就是说一个包对应一个接口。

查AI SDK的文档Foundations: Providers and Models

进去之后发现左上角navigator有一个Providers,那么层级应该是Provider/Model,所以应该要从这里进去了。

如果你没注意到navigator,其实也可以从左边目录的Provider and Models进去。如果“官方文档里没有”,那你可能要从更高层级上找一找。这是看大部分组织良好的官方文档的小技巧。

点进去以后来到了这个页面

分别查看openai,openai-compatible-providers和claude的接口标准

AI SDK Providers: OpenAI

AI SDK Providers: Anthropic

OpenAI Compatible Providers

能看到文档中说明openai Provider包含有/responses请求接口的实现,openai-compatible-providers包含/chat/completions接口的实现,claude包含有/messages接口的实现。这就对应上了。

(反过来怎么找到这的:在官方文档中使用搜索,搜索对应接口去找对应Provider.)

因此我们可以配置接口部分:"npm": "@ai-sdk/openai", // responses接口对应的SDK

由于官方文档中提到,Right Code也支持了老版的/chat/completions接口,所以也可以配置为openai-compatible.

"npm": "@ai-sdk/openai-compatible", // 兼容的SDK

完整的初步配置文件:

{

"$schema": "https://opencode.ai/config.json",

"provider": {

"RC-Codex": { // 和auth中修改的名称一致

"npm": "@ai-sdk/openai", // /responses接口对应的SDK

"name": "RingCode-CodeX", // 在 TUI 中显示的名称

"options": {

"baseURL": "https://www.right.codes/codex/v1",

"apiKey": "666"

},

"models": {

"gpt-5.1-codex-max": { // 中转站支持的模型ID

"name": "Codex-5.1-max(RC-Codex)" //自定义显示名称

},

"gpt-5.1": {

"name": "Gpt-5.1(RC-Codex)"

}

}

}

}

}

现在就可以用了。在后续Options中将提及如何优化模型体验,包括设置思考预算。

recommend 1:Provider可视化配置,一键切换和分流

有很多佬友开发了可视化/后端插件

reference 2:相关文档

1.官方文档 Providers | OpenCode

2.翻译版 提供商 (Providers) – OpenCode 中文文档

comment 3:碎碎念

@coulsontl 佬友的AI-toolbox很好!!但也有一些还没实现的部分:

①不含Skills设置

②目前只能设置Oh-My-Opencode插件中Agents的开关,不含Custom Agents的设置

其实我感觉OMO太重了,而且大多数项目其实并不完全适合OMO的Agents分配方式。要是OMO能完全嵌入Opencode的原生Agents流程就好了!

目前只是偶尔用用OMO,日常开发更喜欢在Opencode中使用各种自定义Agents,后续或许写一个PR来实现不同custom agents的开关,以及更上一层不同Agents组合配置的切换功能。

3.Models配置

3.1 Options配置

配好了转发站,但是模型用起来不好用,可能是因为没有配置Options。Options是厂商自定义的参数列表,例如Codex的思考预算,佬友们常说的Xhigh / high都在options设置。

3.1.1 Options作用

(以Right Code转发站的Codex端点为例展示)

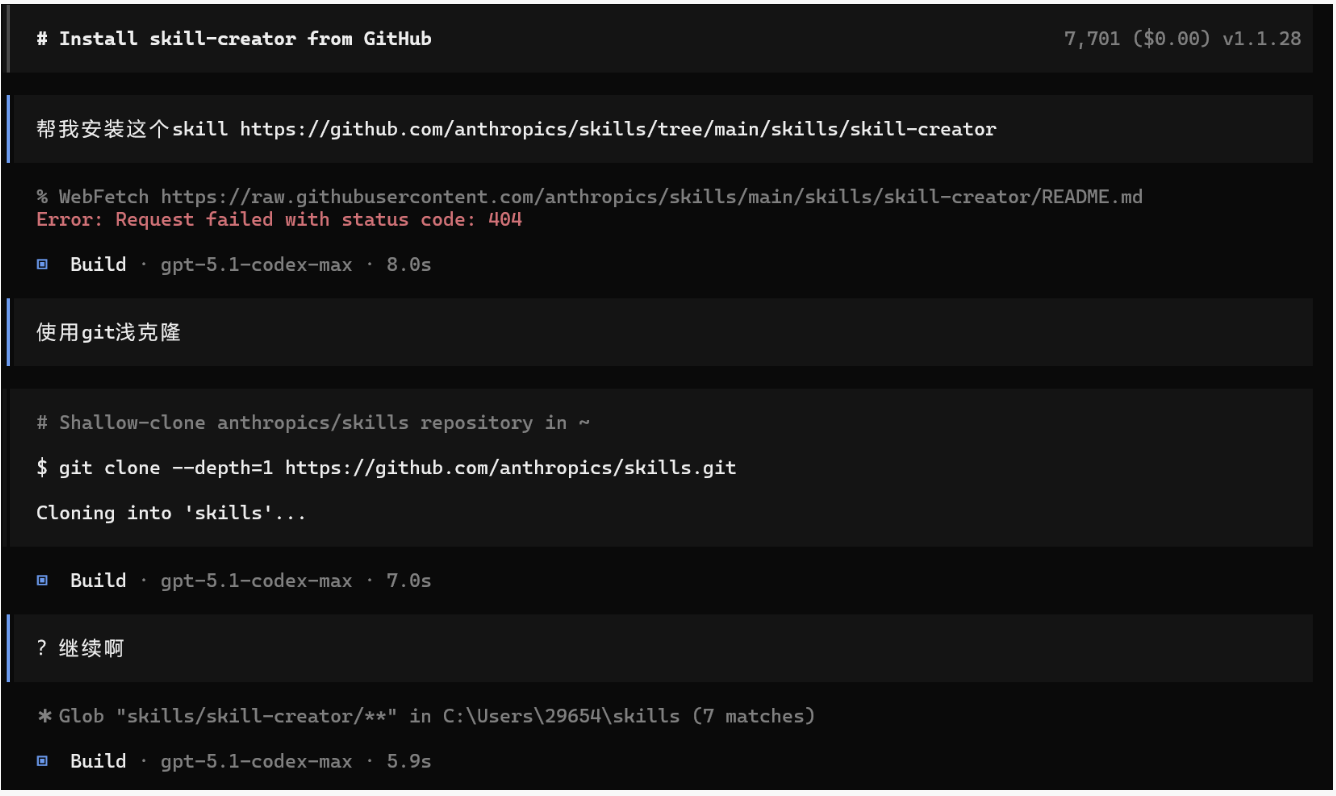

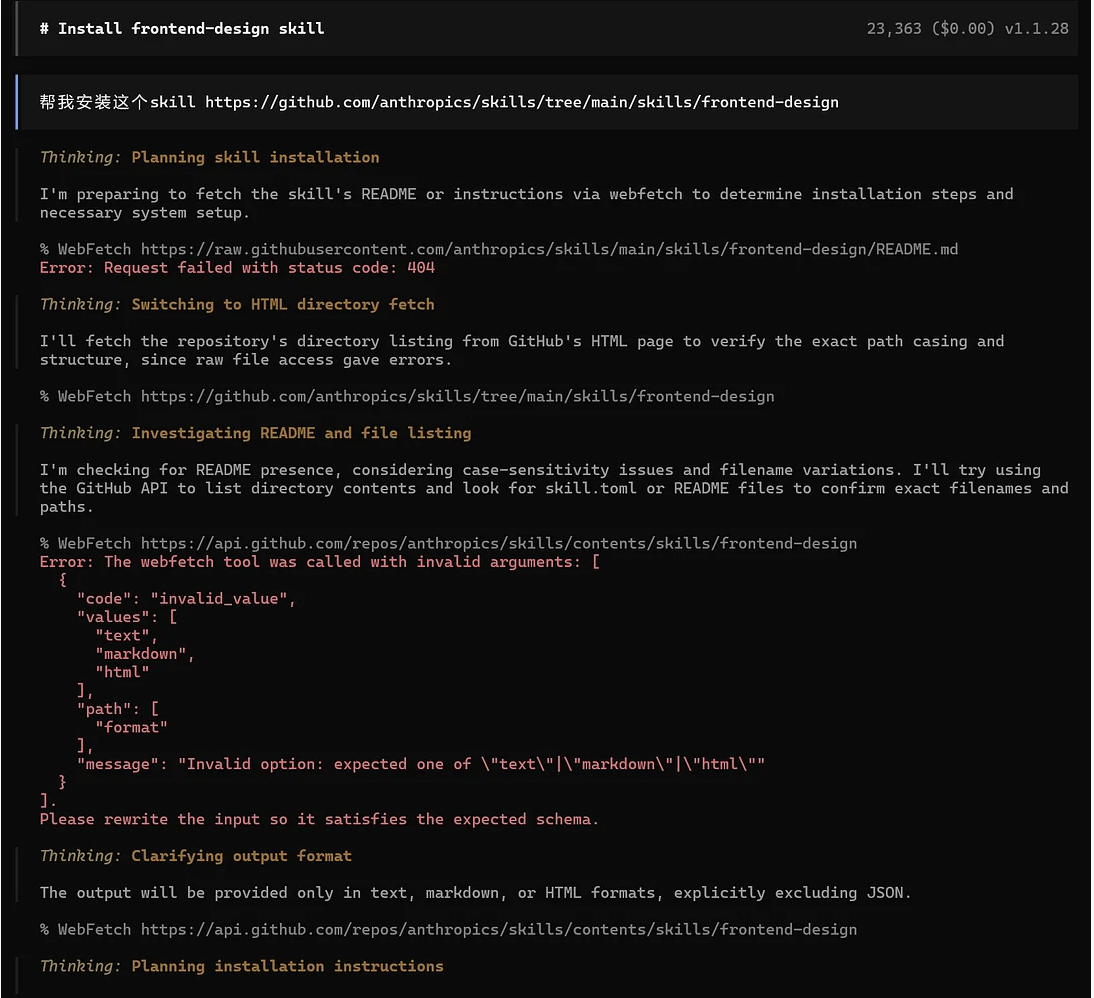

example 1:使用Right Code转发站转发/codex端点,默认配置

可以看到,虽然能返回,但codex-max在每次调用后马上就返回了,也没有展示思考,使用体验很不好。难道codex-max这么蠢吗?或者是被降智了?

example 2:使用Right Code转发站转发/codex端点,增加Options配置

但是如example 2所示,同样的模型和转发站,没有一步一停,也展示了思考内容,花费2分钟。

example 3:config片段对比

在例图1时,我的opencode.json配置对应片段如下:

"RC-Codex": {

"npm": "@ai-sdk/openai",

"name": "RightCode-CodeX",

"options": {

"baseURL": "https://www.right.codes/codex/v1",

"apiKey": "用你的api-key代替",

},

"models": {

"gpt-5.1-codex-max": {

"name": "gpt-5.1-codex-max",

}

}

}

在例图2时,我的opencode.json配置对应片段如下:

"RC-Codex": {

"npm": "@ai-sdk/openai",

"name": "RightCode-CodeX",

"options": {

"baseURL": "https://www.right.codes/codex/v1",

"apiKey": "用你的api-key代替",

},

"models": {

"gpt-5.1-codex-max": {

"name": "gpt-5.1-codex-max",

"options":{

"reasoningEffort": "high",

"textVerbosity": "medium",

"reasoningSummary": "auto"

}

},

}

}

可以看出,问题的关键在于我在options中配置了三个选项reasoningEffort:high,textVerbosity:medium和reasoningSummary:auto  。

。

additional 1:参数作用说明

reasoningEffort代表模型的推理预算,从low到Xhigh(一般推荐设置为high,因为Xhigh可能并没有太明显的帮助,而且有些模型没有Xhigh选项)

textVerbosity控制模型的输出长度,medium代表中等;

reasoningSummary代表模型是否输出thinking的总结(即example2中黄色的thinking:xxx部分),auto代表自动控制思考总结的长度。

3.1.2 Options配置

document-reading 2:通过阅读OpenCode官方文档配置codex模型和claude模型options

这种时候我们要寻求Opencode 官方文档的帮助。

step1:

首先根据 Models | OpenCode opencode是基于Vercel的AI SDK项目和models.dev项目的,所以去查看这两个项目的官方文档。

step2:

查AI SDK的文档Foundations: Providers and Models

进去之后发现左上角navigator有一个Providers,那么层级应该是Provider/Model/Options,所以应该要从这里进去了。如果你没注意到navigator,其实也可以从左边目录的Provider and Models进去。如果“官方文档里没有”,那你可能要从更高层级上找一找。这是看大部分组织良好的官方文档的小技巧。

step3:

点进去以后来到了这个页面

AI SDK Providers

分别查看openai和claude的接口标准

(为什么查看这两个接口请参考notification 1&2):

AI SDK Providers: OpenAI

AI SDK Providers: Anthropic

能看到文档中已经详细说明了每个options有什么含义及如何填写。

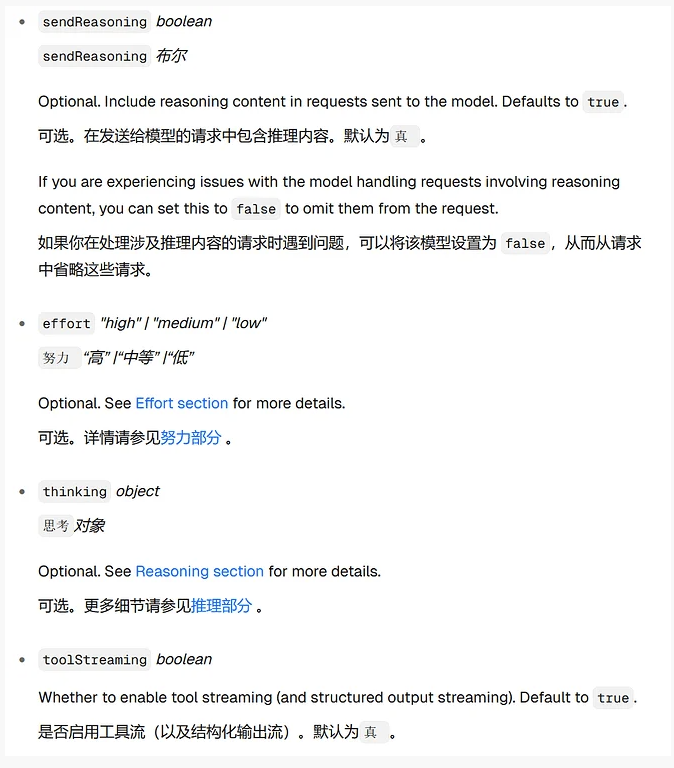

notification 1:Options跟随Models变化,而不是Provider或中转站

options配置隶属于models配置,不同Provider提供的请求接口不同,options的设置也因此完全不同,例如codex系列模型通过OPENAI的/responses接口请求,claude系列模型则通过ANTROPIC的/messages接口请求,因此,一个中转站的不同Provider模型应该遵循不同的options设置。

进一步地,同一个Provider(厂商),相同接口的不同模型也可能支持不同的options设置,例如codex的部分模型虽然也使用openai/responses接口,但却不支持思考预算为xhigh的设置;gemini的生图模型和推理模型显然不能遵循同样的options设置。

因此,最好的方式是为每个常用模型分别设置options。

具体请参考document-reading 1 中AI-SDK不同Providers页面下的相关接口实现。

分辨你的常用模型使用哪个接口,并确定其是否满足接口的所有options参数。

设置无效的options不会引发报错,但可能毫无作用,进而可能导致example 1中模型不能发挥出应有实力的表现。

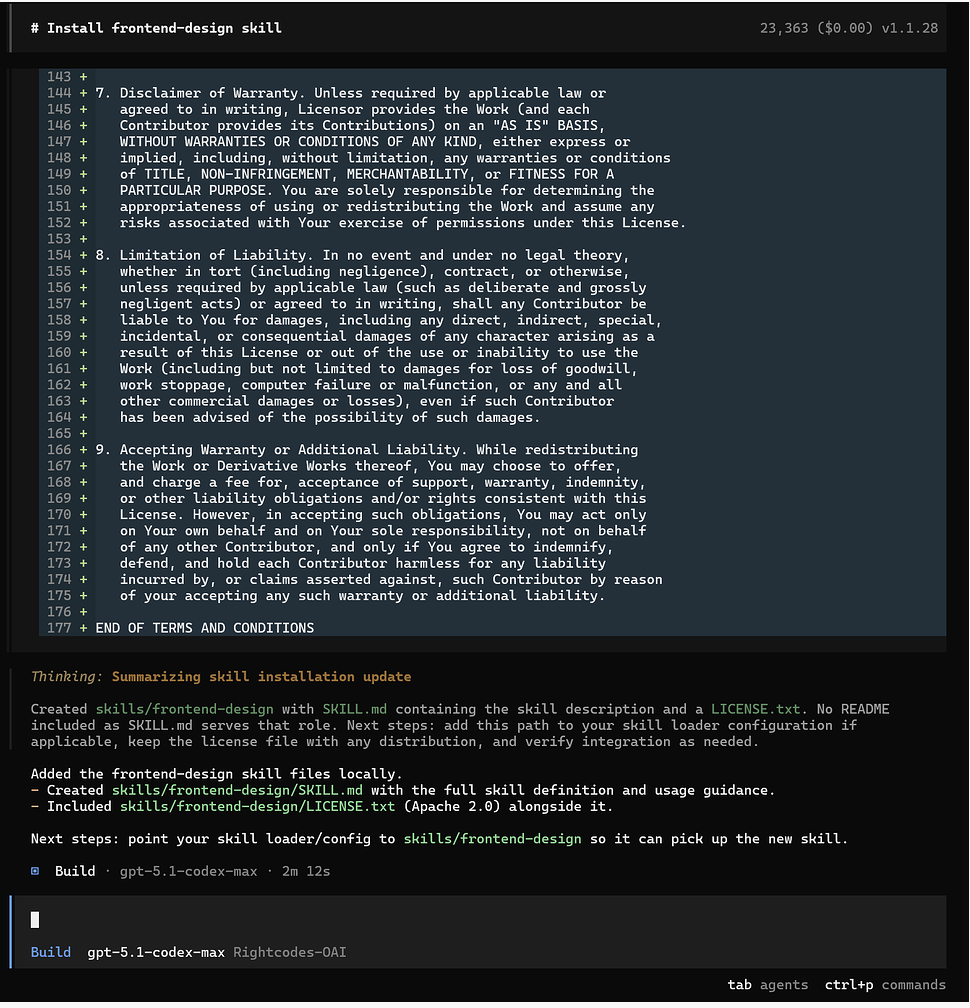

action 6:配置codex-5.2模型的Options

根据上文的document-reading,我们配置gpt-5.2-codex模型的model options

这里配置了三个Options.为什么如此配置请参考前文中document-reading 2

完整版config:

配置前:

{

"$schema": "https://opencode.ai/config.json",

"provider": {

"rc-codex": {

"npm": "@ai-sdk/openai",

"name": "RC-Codex",

"options": {

"baseURL": "https://www.right.codes/codex/v1",

"apiKey": "666"

},

"models": {

"gpt-5.2-codex": {

"name": "Codex-5.1-max(RC-Codex)"

}

}

}

},

}

配置后:

{

"$schema": "https://opencode.ai/config.json",

"provider": {

"rc-codex": {

"npm": "@ai-sdk/openai",

"name": "RC-Codex",

"options": {

"baseURL": "https://www.right.codes/codex/v1",

"apiKey": "666"

},

"models": {

"gpt-5.2-codex": {

"name": "Codex-5.1-max(RC-Codex)",

"options":{

"reasoningEffort": "high",

"textVerbosity": "medium",

"reasoningSummary": "auto"

}

}

}

}

},

}

document-reading 3:通过阅读OPENAI官方文档进一步配置codex模型options

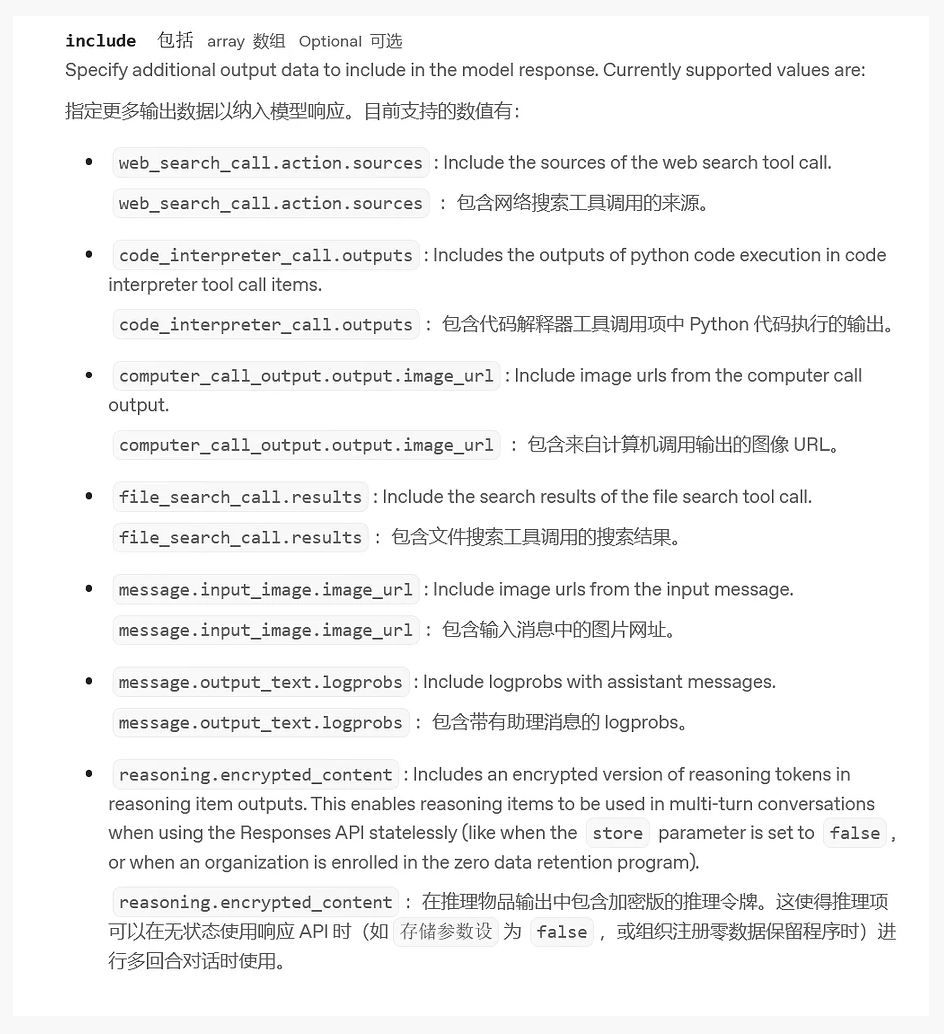

AI-SDK的文档当然已经非常够用了,不过如果你想更深程度的了解究竟有哪些options,那么AI-SDK的文档里还是没有写的完全清楚,例如在include这里,AI-SDK只写了两个支持的值,实际上这里不止两个值可以填。

其实我们还可以去检查OPENAI和ANTROPIC的官方文档来确认究竟有哪些options。

这里以OPENAI为例:我们查找官方文档中关于Reponses API的部分(善用文档库自带的搜索框)可以看到include列表一共有七个可选的值。

有任何关于你想要的模型自主设置也可以继续在responses api里探索。responses api是许多模型共用的接口,你使用的模型可能并不支持该接口的所有功能。

https://platform.openai.com/docs/api-reference/responses/create

notification 2:不同中转站实现的接口可能不同

本文以配置Right Code家的codex和claude为例。在 RightCode官方文档 中,codex实现的接口为OPENAI 官方的responses接口,因此应该遵循responses接口的options设置。claude实现的接口为ANTROPIC官方的messages接口,因此应该遵循messages接口的options设置。

3.2 Variants配置

Variants实际上就是一个List,其中的每个元素是一个Options设置。通过切换不同的Variants,我们实际上能够切换不同的Options组合。参考文档:Models | OpenCode

原配置一个模型只能有一个设置:

"gpt-5.2-codex": {

"name": "gpt-5.2-codex",

"options":{

"reasoningEffort": "high",

"textVerbosity": "medium",

"reasoningSummary": "auto"

}

},

现在我想针对这个模型切换不同的Options组合,则把它们打包到Variants列表里.

"gpt-5.2-codex": {

"name": "gpt-5.2-codex",

"variants": {

"high": {

"reasoningEffort": "high",

"textVerbosity": "low",

},

"xhigh": {

"reasoningEffort": "xhigh",

"textVerbosity": "medium",

},

},

},

可以看到,现在可以调整xhigh和high进行推理了.

4.留言

Plugins配置,如Oh-My-Opencode配置等站内已有其他轮子,不再赘述;

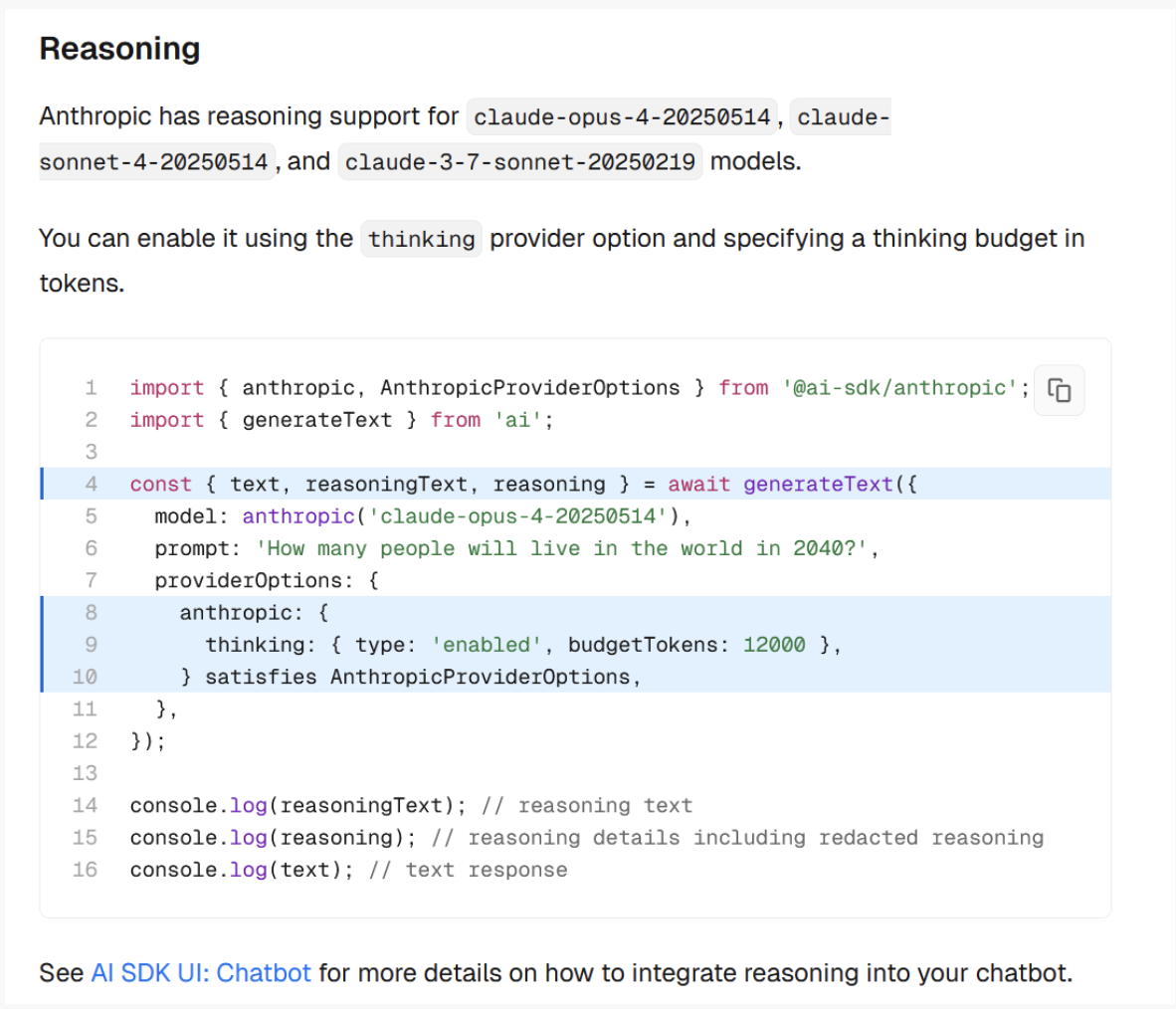

exercise 1:完善Right Code/Claude 4.5 Opus模型的初始opencode.json文件

题目:

{

"$schema": "https://opencode.ai/config.json",

"provider": {

"RCS-Claude": {

"npm": "@ai-sdk/anthropic",

"name": "RC中转站Claude端点(awsq)",

"options": {

"baseURL": "https://www.right.codes/claude-aws/v1",

"apiKey": "666"

},

"models": {

"claude-opus-4-5-20251101": {

"name": "claude-opus-4-5-20251101"

}

}

}

},

"model": "RCS-Codex/gpt-5.1",

"small_model": "opencode/grok-code"

}

答案供参考:

{

"$schema": "https://opencode.ai/config.json",

"provider": {

"RCS-Claude": {

"npm": "@ai-sdk/anthropic",

"name": "RC中转站Claude端点(awsq)",

"options": {

"baseURL": "https://www.right.codes/claude-aws/v1",

"apiKey": "666"

},

"models": {

"claude-opus-4-5-20251101": {

"name": "claude-opus-4-5-20251101",

"variants":{

"very-lazy": {

"effort": "low"

},

"think-2000":{

"thinking": { "type": "enabled", "budgetTokens": 2000 },

},

"think-1w6":{

"thinking": { "type": "enabled", "budgetTokens": 16000 },

},

}

}

}

}

},

"model": "RCS-Codex/gpt-5.1",

"small_model": "opencode/grok-code"

}

不兼容的options不会生效,但问题在于也不会报错.它们只是影响你的模型”智力”.

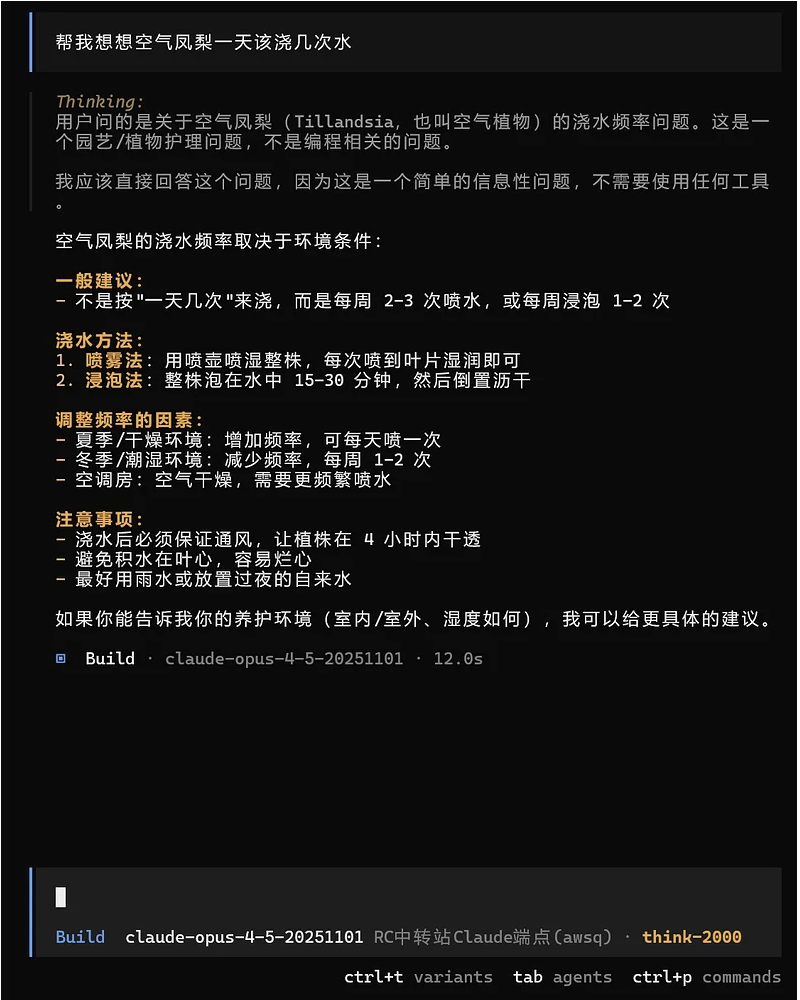

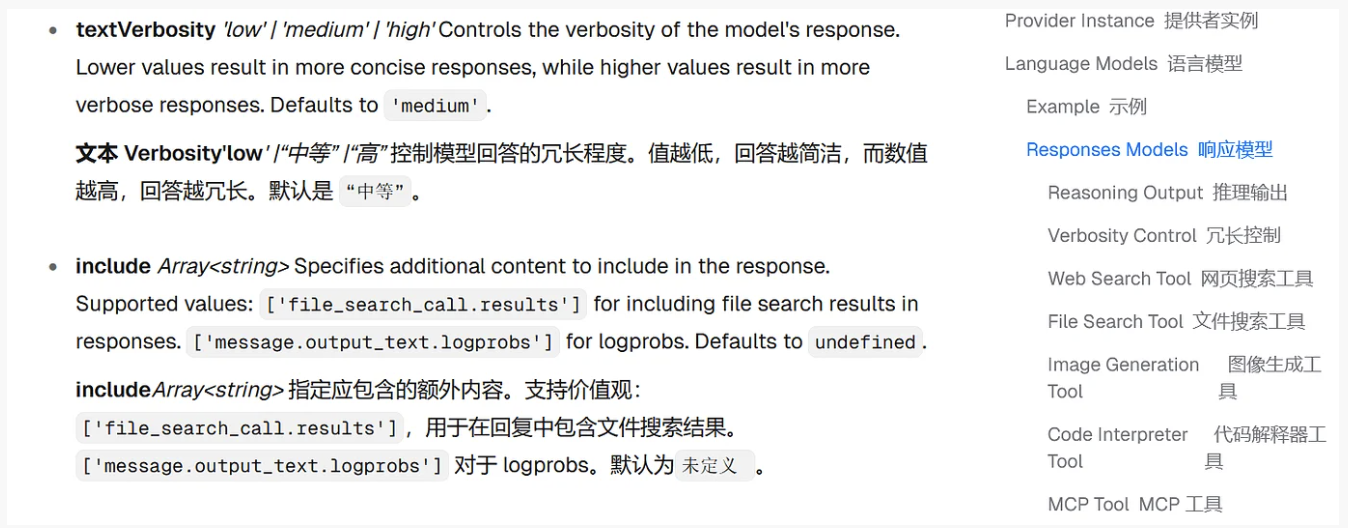

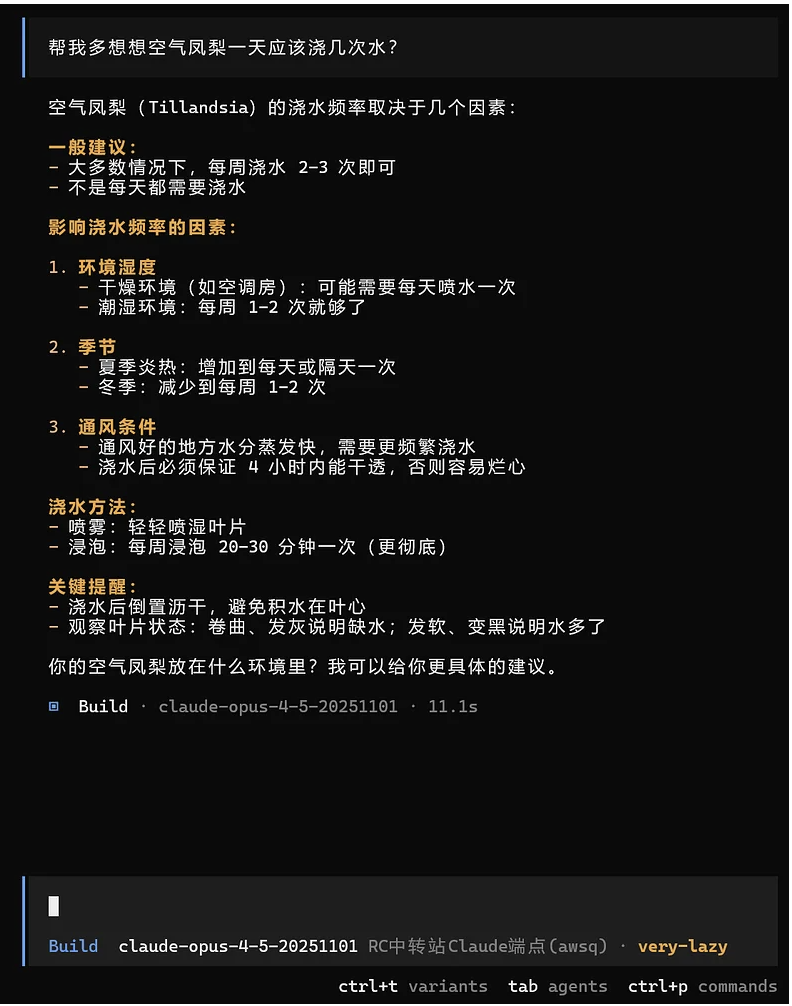

习题1参考答案效果展示

配置1:opus4.5 very-lazy

不进行思考,Effort(努力值)为低,即“降智”。Effort不设置时默认为高

配置2:opus4.5 think-2000:

(思考预算为2000,进行简单的思考)

配置3:opus4.5 think-16000:(思考预算为16000)

thinking budget = 16000.可以看出,思考明显更充分

这三张图片对应exercise 1中我对opus4.5所修改的配置.

同一个模型显示出三种不同的效果,展示了options配置的必要性.